أصدرت شركة الذكاء الاصطناعي الإسبانية Multiverse Computing نسخة مضغوطة من gpt-oss-120B الخاص بـ OpenAI تحت اسم HyperNova 60B 2602، ونشرتها مجانًا على Hugging Face.

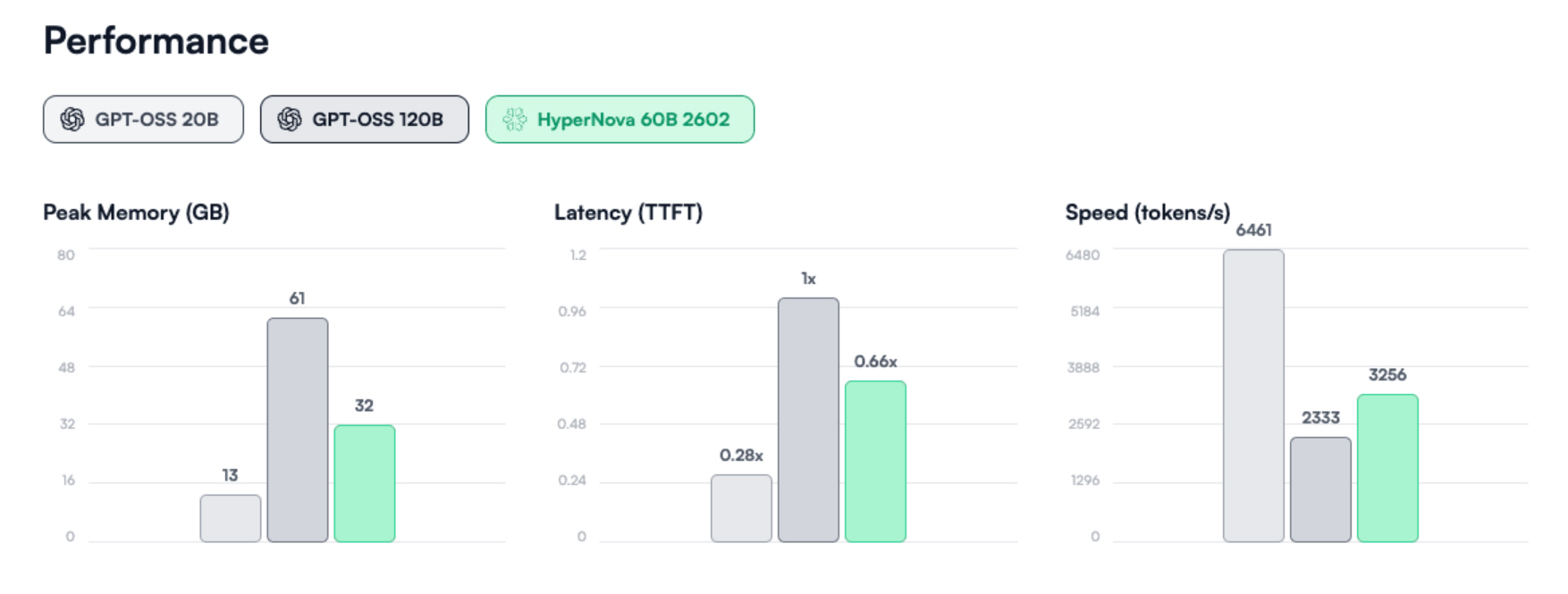

تخفض النسخة الجديدة احتياجات الذاكرة للنموذج الأصلي من 61 جيجابايت إلى 32 جيجابايت، وتقول Multiverse إنها تحتفظ بأداء قريب من أداء الاتصال بالأدوات على الرغم من تقليص الحجم بنسبة 50%.

من الناحية النظرية، يعني هذا أن نموذجًا كان يحتاج في السابق إلى بنية تحتية ضخمة يمكن أن يعمل على أجهزة أقل بكثير. بالنسبة للمطورين الذين لديهم ميزانيات ضيقة أو قيود طاقة، فهذه ميزة كبيرة محتملة.

تقنية CompactifAI

تدعي Multiverse تحقيق مكاسب في المعايير التي تركز على الوكلاء مقارنة بإصدارها المضغوط السابق. تقول إن HyperNova 60B 2602 تحقق تحسينًا بخمسة أضعاف على Tau2-Bench ومرتين على Terminal Bench Hard.

تقيس تلك الاختبارات استخدام الأدوات وسير العمل البرمجي بدلاً من الردود البسيطة النصية.

تقوم تقنية CompactifAI الخاصة بالشركة بإعادة هيكلة مصفوفات أوزان المحولات باستخدام شبكات التنسور المستوحاة من الكم.

تعتقد Multiverse أن الضغط الفعال يوفر بديلاً عن بناء نماذج أكبر فأكبر، وتربط هذه الرؤية بالمناقشات الأوروبية الجارية حول الذكاء الاصطناعي السيادي، وحدود البنية التحتية، واستخدام الطاقة – لذا لمعرفة المزيد، تحدثت مع الشركة عن تقنيتها في الضغط.

- كيف يمكنك ضغط نموذج كبير للغة؟

تقوم Multiverse Computing بضغط نماذج اللغة الكبيرة باستخدام تقنية CompactifAI الخاصة بها، المستندة إلى شبكات التنسور المستوحاة من الكم.

بدلاً من إزالة المعلمات ببساطة، تعيد CompactifAI هيكلة مصفوفات الوزن الداخلية لنماذج المحولات إلى تمثيلات عالية الكفاءة لشبكات التنسور. تلتقط هذه إعادة الصياغة الرياضية الارتباطات بين المعلمات وتلغي الازدواجية الهيكلية.

تطبق هذه العملية بعد التدريب، مما يعني أن النموذج الأصلي لا يحتاج إلى إعادة تدريب وأن الوصول إلى بيانات التدريب الأصلية ليس مطلوبًا.

باستخدام هذا النهج، يمكن لـ CompactifAI تقليل استخدام الذاكرة بنسبة تصل إلى حوالي 93% وتقليل عدد المعلمات بشكل كبير، مع الحفاظ على أداء قوي عبر المهام.

النماذج المضغوطة الناتجة أصغر وأسرع وأكثر كفاءة في استخدام الطاقة وأسهل في النشر عبر السحابة، والموقع المحلّي، والبيئات المحيطة.

- هل يمكنك تطبيقها على كل نموذج ضخم للغة؟

تعمل على نماذج اللغة الكبيرة المستندة إلى المحولات، بما في ذلك نماذج الأساس الكثيفة، شريطة أن يكون الوصول إلى أوزان النموذج متاحًا.

التقنية غير مرتبطة بهيكل معمارية محددة ضمن عائلة المحولات ولا تتطلب تغييرات على سلوك النموذج الخارجي أو واجهات برمجة التطبيقات (APIs).

تعتمد فعالية الضغط على مستوى الازدواجية في النموذج. عادةً ما توفر النماذج الكبيرة المفرطة المعلمات أكبر إمكانات للضغط.

- ما هي التحديات؟

التحدي الفني الأساسي هو الحفاظ على دقة النموذج مع تحقيق معدلات ضغط عالية. يتم التعامل مع ذلك من خلال التحكم بعناية في معلمات تحليل التنسور لتحقيق توازن بين تقليل الحجم وثبات الأداء.

تحدٍ آخر هو التأكد من أن النماذج المضغوطة تحتفظ بالقوة عبر مهام مختلفة، بما في ذلك الاستدلال، والأداء متعدد اللغات، والحالات الخاصة بالمجال.

أخيرًا، تختلف بيئات النشر على نطاق واسع. يجب تحسين الضغط لأهداف الأجهزة المختلفة ومتطلبات الكمون والقيود التشغيلية.

- ما هو التشبيه المناسب؟

إعادة كتابة المخطط، وليس إزالة الطوب: لا تقوم CompactifAI ببساطة بإزالة أجزاء من النموذج. بدلاً من ذلك، فإنها تعيد كتابة المخطط الرياضي بحيث يتم تمثيل نفس الهيكل بشكل أكثر كفاءة.

إنه كإعادة تصميم إطار مبنى داخلي بحيث يستخدم مواد أقل بكثير مع الحفاظ على القوة والوظائف.

تشبيه آخر هو إعادة تنظيم أرشيف ضخم إلى نظام منظم للغاية يلغي التكرار. تبقى المعرفة متماسكة، ولكن يتم ترميزها بكفاءة أكبر بكثير.

- كيف تحدد فقدان الدقة؟

يتم تحديد فقدان الدقة من خلال تقييم النموذج المضغوط ضد النموذج الأصلي في نفس المهام ومقاييس الدرجات، ثم قياس التغيير.

في الممارسة العملية، يشمل ذلك تقييمات الاتصال بالأدوات. يقلل تقليل الفقد في القدرة هنا من الإمكانيات المتقدمة لوظائف الوكلاء وتطبيقات البرمجة.

- ما هي الشركات الأخرى (ربما المنافسة) التي تعمل على نفس التقنية؟

تقنية الضغط الخاصة بـ Multiverse Computing فريدة تمامًا، تستند إلى الأبحاث حول شبكات التنسور المستوحاة من الكم التي قام بها المؤسس المشارك والرئيس التنفيذي رومان أورس.

على الرغم من وجود تقنيات أخرى متاحة لضغط نماذج الذكاء الاصطناعي، إلا أنها تأتي مع تكلفة أعلى بكثير من فقدان الدقة.

- بالنظر إلى حقيقة أن النماذج الكبيرة للغة تتطور بشكل عضوي مع مرور الوقت، ما قد يكون مستقبل ضغطك (قد تكون تطبيقات الأجهزة؟) أو شيء آخر؟

يمكن تطبيق تقنية الضغط هذه أيضًا على النماذج الكبيرة للغة القادمة، مما يعني أنه في المستقبل، ستتمكن أجهزة مثل السيارات، الهواتف، الحواسيب المحمولة وما إلى ذلك من تشغيل نماذج ذكاء اصطناعي صغيرة أو نانو مثبتة مسبقًا على عتادها.

- هل هي معمارية غير مرتبطة بالأجهزة؟ هل تعمل بشكل أفضل مع بعض الأجهزة (ASIC) أكثر من غيرها؟

نعم، إنها غير مرتبطة بالأجهزة على مستوى النموذج: تقوم CompactifAI بضغط أوزان النموذج بعد التدريب، بحيث يمكن نشر النموذج الناتج عبر السحابة، على الموقع، والحواف دون تغيير الواجهة الخارجية للنموذج.

تعتمد تسريع الاستدلال على ما كان يحدك من قبل: إذا كنت محدود الذاكرة، فإن النموذج الأصغر غالبًا ما يعمل بشكل أسرع بكثير وأرخص على نفس الأجهزة.

ولا تتطلب جهاز ASIC، لكن وحدات معالجة الرسوميات/المسرعات الصناعية ستقدم عادةً أعلى إنتاجية لاستدلال المحولات بمجرد أن يتناسب النموذج بشكل مريح في الذاكرة.

- على ماذا يعتمد الضغط؟

يعتمد CompactifAI على الازدواجية في مصفوفات أوزان المحولات المدربة: غالبًا ما تكون النماذج الكبيرة مفرطة المعلمات، لذا يمكن تمثيل نفس السلوكيات مع عدد أقل من المعلمات الفعالة.

بدلاً من الضغط العام على غرار “zip”، فإنه يستخدم تحليل واعي للنموذج (شبكات التنسور المستوحاة من الكم) لإعادة كتابة المصفوفات الكبيرة في شكل أصغر منظم مع التخفيف من تكلفة الدقة.

- ما الذي يمنع الآخرين من نسخ تقنياتك/عملياتك؟ يشبه تقنيات الضغط المتنوعة المتاحة (مثل zip، rar، 7z، إلخ)

تقنية CompactifAI المملوكة لشركة Multiverse Computing هي نهج فريد لضغط نماذج الذكاء الاصطناعي، تستند إلى الأبحاث حول شبكات التنسور المستوحاة من الكم التي أجراها المؤسس المشارك والرئيس التنفيذي رومان أورس، وفريق البحث الخاص بالشركة.

ما يمنع تقنيات التقليد هو المعرفة الفنية المطلوبة لتحقيق معدلات ضغط عالية دون التضحية بالدقة.

يمكن أن تقلل CompactifAI من حجم النموذج بحوالي 95% مع فقد دقة بنسبة 2-3% فقط، مقارنةً بمعيار الصناعة الذي يقدر بفقد دقة بنسبة 20-30% بعد ضغط يتراوح بين 50-60% فقط.

تابع TechRadar على أخبار Google و أضفنا كمصدر مفضل للحصول على أخبارنا، والمراجعات، والآراء من خبرائنا في تغذياتك. تأكد من النقر على زر المتابعة!

وطبعًا يمكنك أيضًا متابعة TechRadar على تيك توك للحصول على الأخبار والمراجعات والفيديوهات الخاصة بالمشتريات، واحصل على تحديثات منتظمة منا عبر واتساب أيضًا.